La Inteligencia Artificial y su demanda de electricidad

Cuando enviamos una petición a una inteligencia artificial como ChatGPT, los servidores de un centro de datos computan la respuesta. Hasta aquí, el proceso es similar a cualquier servicio en la nube, pero los modelos de IA generativa, que han sido entrenados para predecir las respuestas, utilizan 33 veces más energía que las máquinas que ejecutan un algoritmo tradicional para realizar tareas específicas.

«Los Centros de Datos necesitarán el consumo de electricidad equivalente a un país como Japón en 2026″

La IA generativa es cada vez más popular, lo que significa que millones de personas hacen consultas a cada instante que ponen a funcionar la maquinaria de la inferencia: el proceso por el que los modelos de aprendizaje automático realizan predicciones o generalizaciones a partir de cualquier consulta.

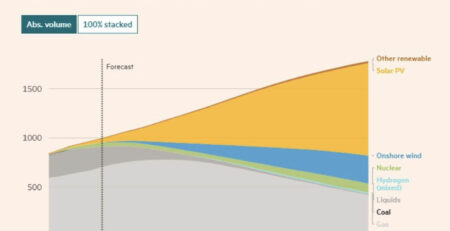

Este proceso es igualmente costoso porque genera contenido desde cero en los centros de datos de todo el mundo. Centros de datos que utilizan cada vez más electricidad: de 460 TWh en 2022 a más de 1.000 TWh estimados para 2026; aproximadamente el consumo de electricidad de Japón, que tiene una población de 125 millones de personas.

En National Grid, el operador de la red eléctrica de Reino Unido, están preocupados. Calculan que la demanda de electricidad de los centros de datos se multiplicará por 6 en los próximos 10 años por el uso de la IA.

Aunque los centros de datos suelen tener instalaciones de autoconsumo, esto va a requerir soluciones más drásticas. Por eso empresas como Microsoft empiezan a pensar en reactores nucleares modulares, mientras que OpenAI, estudia soluciones con fusión nuclear.